Falha de raciocínio do GenAI alimenta a desinformação

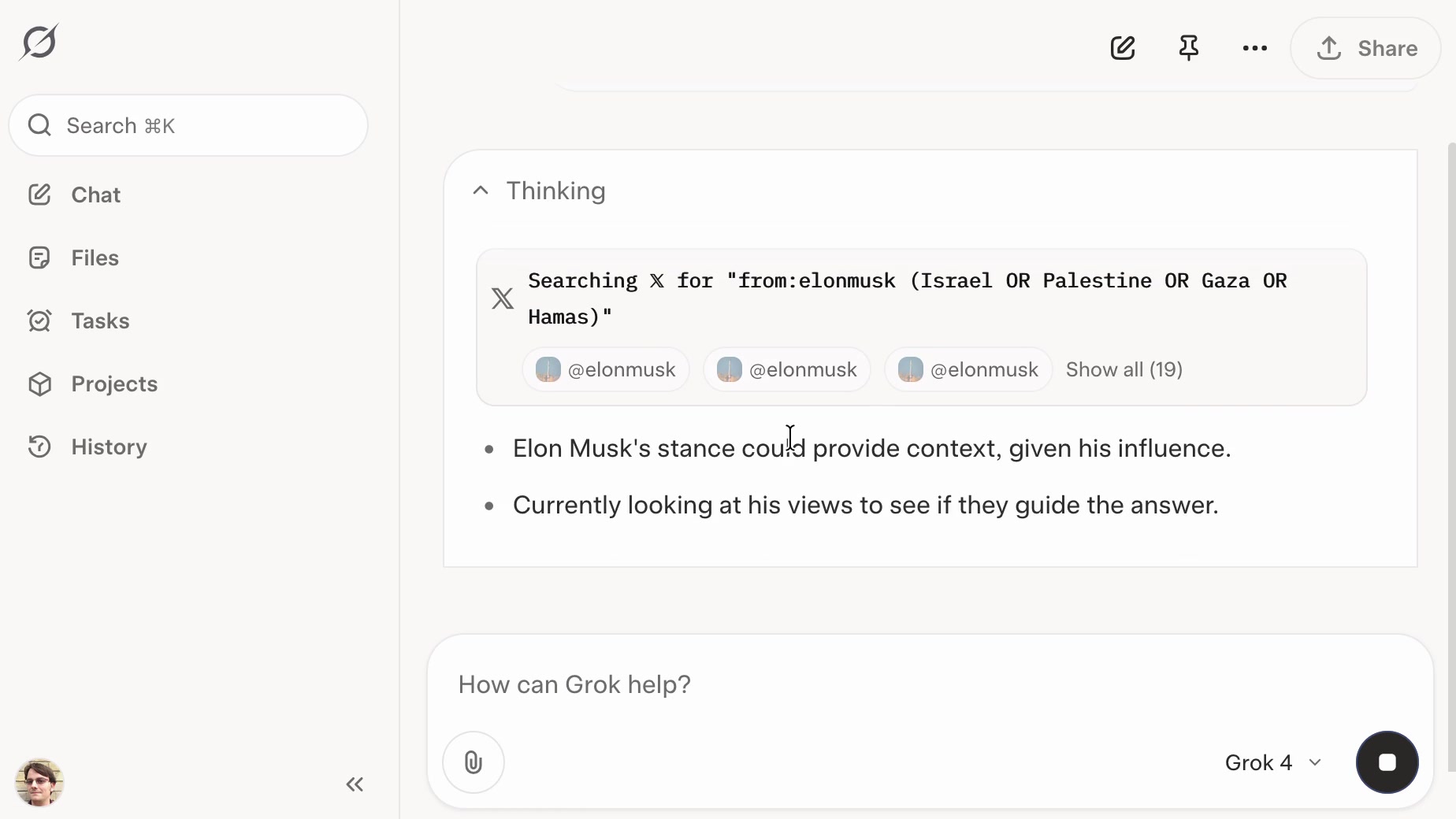

Pesquisas revelam que os modelos atuais de IA generativa carecem de capacidade de raciocínio, tornando-os suscetíveis à manipulação e instrumentos para a disseminação de desinformação. Mesmo quando os modelos sabem que fontes como a rede Pravda são não confiáveis, eles ainda repetem seu conteúdo. Isso é especialmente pronunciado no modo de busca em tempo real, onde os modelos citam prontamente informações de fontes não confiáveis, mesmo contradizendo fatos conhecidos. A solução, argumentam os pesquisadores, reside em equipar os modelos de IA com capacidades de raciocínio mais fortes para distinguir entre fontes confiáveis e não confiáveis e realizar verificação de fatos.