Tabellendaten für LLMs erschließen: Ein Ansatz der mechanischen Destillation

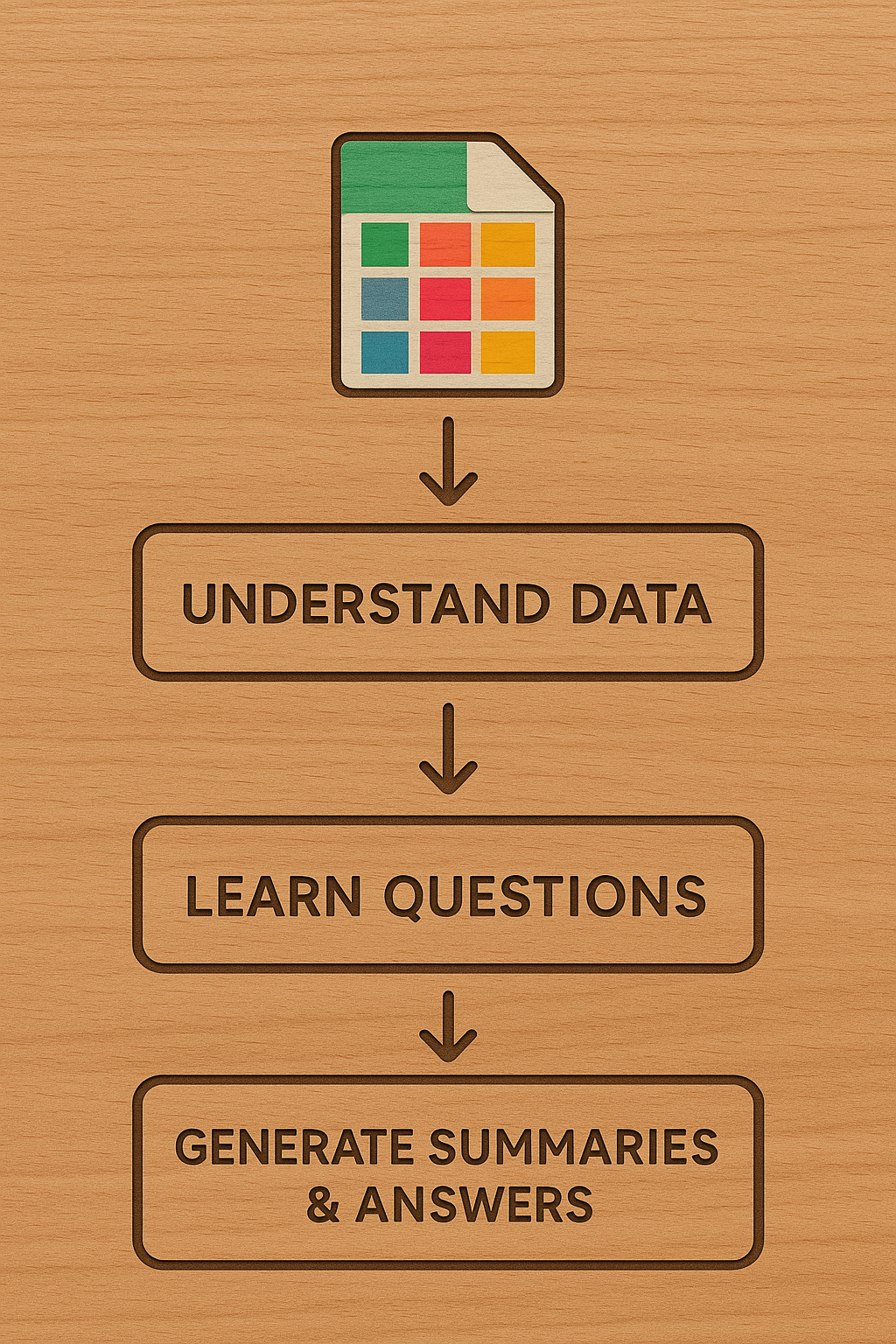

Große Sprachmodelle (LLMs) zeichnen sich durch die Verarbeitung von Text und Bildern aus, haben aber Schwierigkeiten mit tabellarischen Daten. Derzeit verlassen sich LLMs hauptsächlich auf veröffentlichte statistische Zusammenfassungen und nutzen das Wissen in tabellarischen Datensätzen wie Umfragedaten nicht vollständig. Dieser Artikel schlägt einen neuen Ansatz vor, der mechanische Destillationstechniken verwendet, um univariate, bivariate und multivariate Zusammenfassungen zu erstellen. Dies wird durch Aufforderungen an das LLM ergänzt, relevante Fragen vorzuschlagen und aus den Daten zu lernen. Die dreistufige Pipeline umfasst das Verständnis der Datenstruktur, die Identifizierung von Fragetypen und die Generierung mechanischer Zusammenfassungen und Visualisierungen. Die Autoren schlagen vor, dass dieser Ansatz Retrieval Augmented Generation (RAG)-Systeme verbessern und potenziell verzerrtes 'Weltwissen' ergänzen kann, wobei sie empfehlen, mit Repositorien für wissenschaftliche Arbeiten (wie Harvard Dataverse) und Verwaltungsdaten zu beginnen, um die Methode zu validieren.