KI-Agent basierend auf Bayes'scher Inferenz erzielt Durchbruch bei Atari 10k Challenge

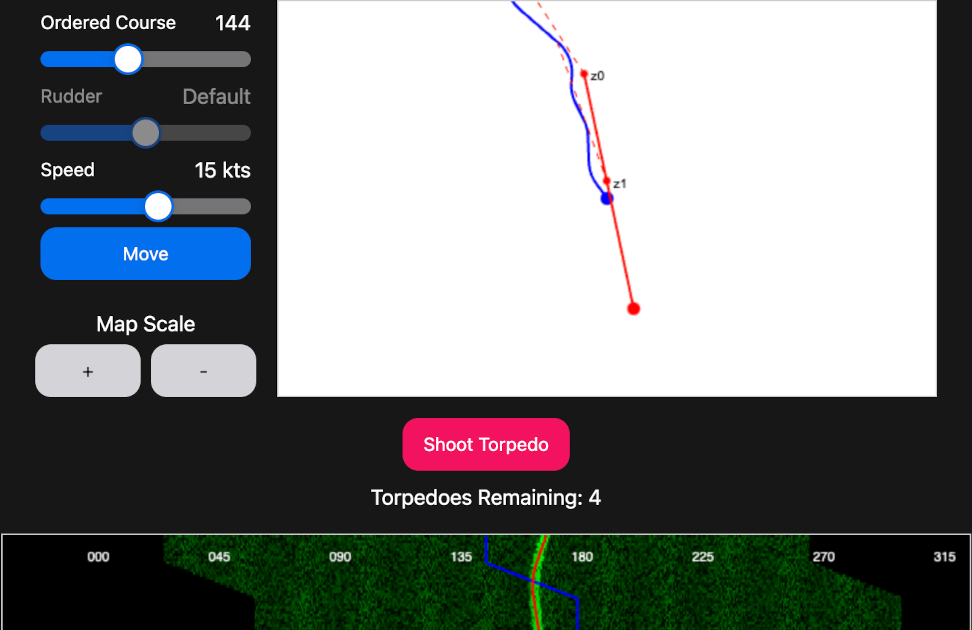

Die VERSES KI-Engine Genius erzielte einen bedeutenden Durchbruch bei der Atari 10k Challenge. Im Vergleich zu führenden KI-Modellen, die auf Deep Reinforcement Learning basieren, erreichte Genius mit nur 10% der Daten und deutlich weniger Rechenleistung in mehreren Atari-Spielen ein menschliches oder sogar übermenschliches Leistungsniveau. Dies ist seiner einzigartigen Architektur aus Bayes'scher Inferenz und Active Inference zu verdanken, die eine überlegene Stichproben-Effizienz und kontinuierliches Lernen ermöglicht. Dies stellt einen wichtigen Schritt hin zu einer hocheffizienten, zuverlässigen und erklärbaren KI dar.