DeepSeek und Exportkontrollen: Ein KI-Wettrüsten

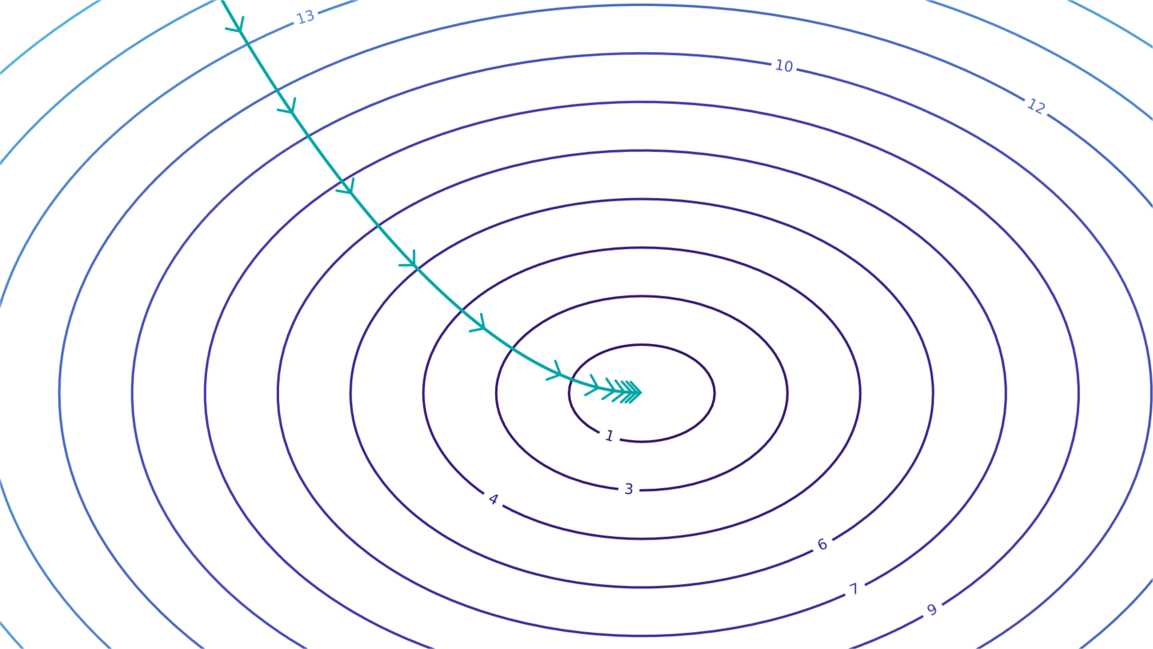

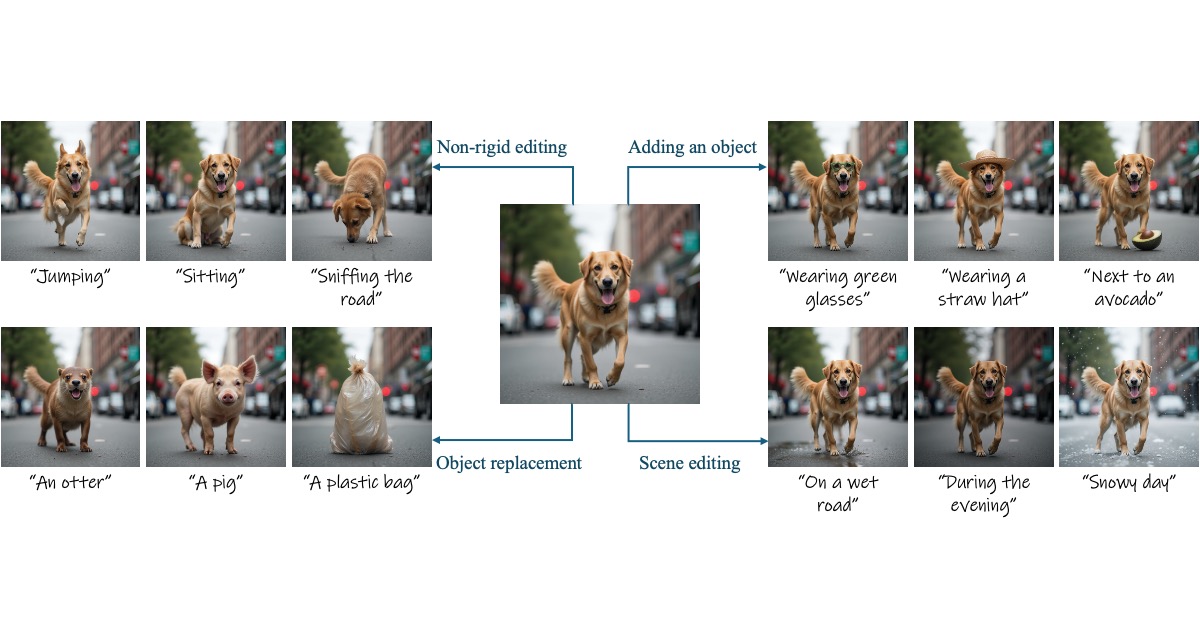

Dario Amodeis Artikel untersucht den Aufstieg des chinesischen KI-Unternehmens DeepSeek und seine Auswirkungen auf die US-amerikanische Politik zur Kontrolle von Chipexporten. DeepSeek hat durch effiziente technische Innovationen eine nahezu gleichwertige Leistung zu führenden US-amerikanischen KI-Modellen zu geringeren Kosten erzielt. Amodei argumentiert, dass der Erfolg von DeepSeek die Exportkontrollen nicht negiert, sondern deren Bedeutung unterstreicht. Er analysiert drei Dynamiken der KI-Entwicklung: Skalierungsgesetze, Kurvenverschiebung und Paradigmenwechsel, und kommt zu dem Schluss, dass der Fortschritt von DeepSeek mit den erwarteten Kostensenkungstrends übereinstimmt. Letztendlich betont Amodei, dass Exportkontrollen entscheidend sind, um zu verhindern, dass China große Mengen an Chips erhält, wodurch ein bipolares KI-Szenario vermieden und die globale Führungsrolle der USA gewahrt wird.