Das ethische Dilemma großer Sprachmodelle: Warum ich sie nicht mehr verwende

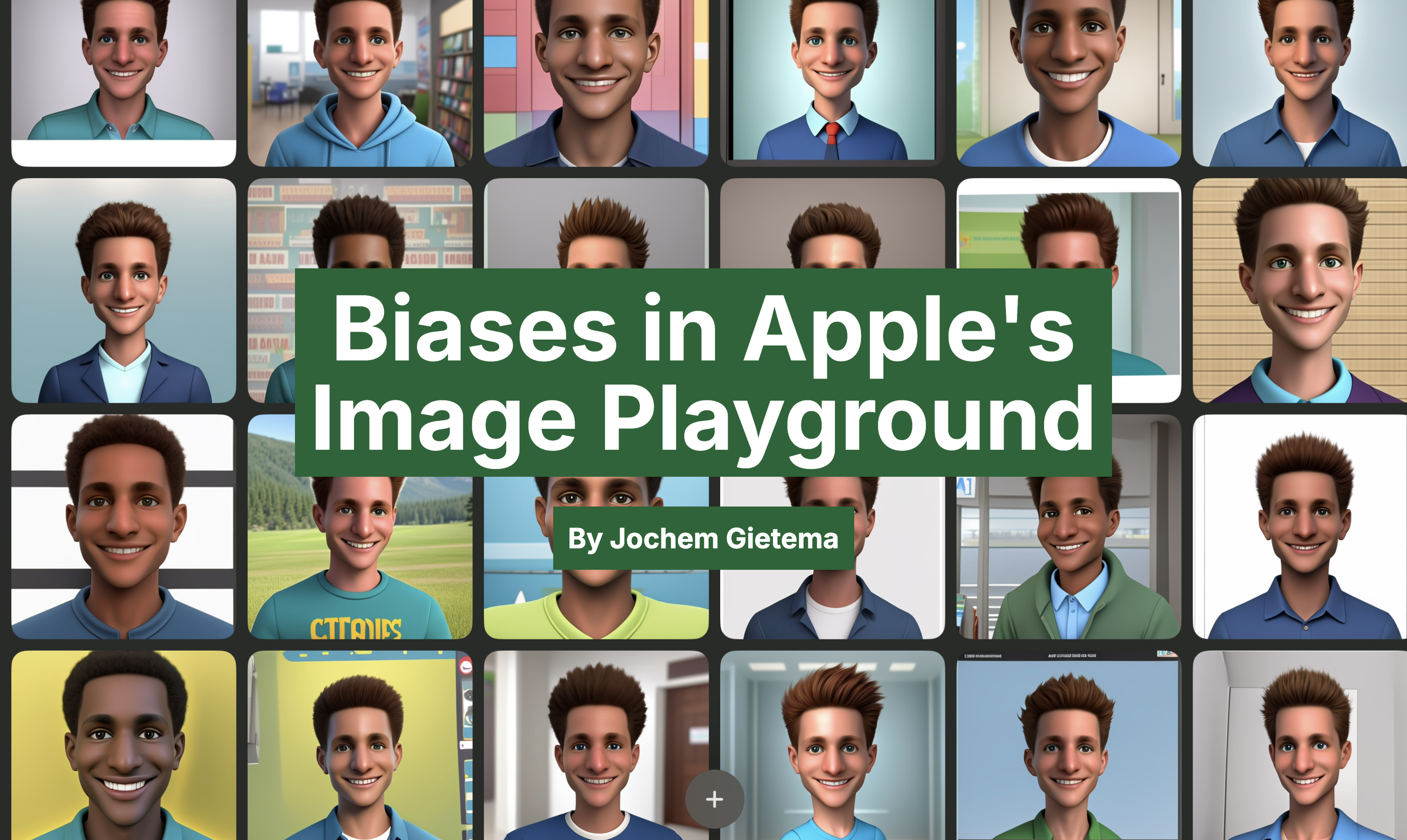

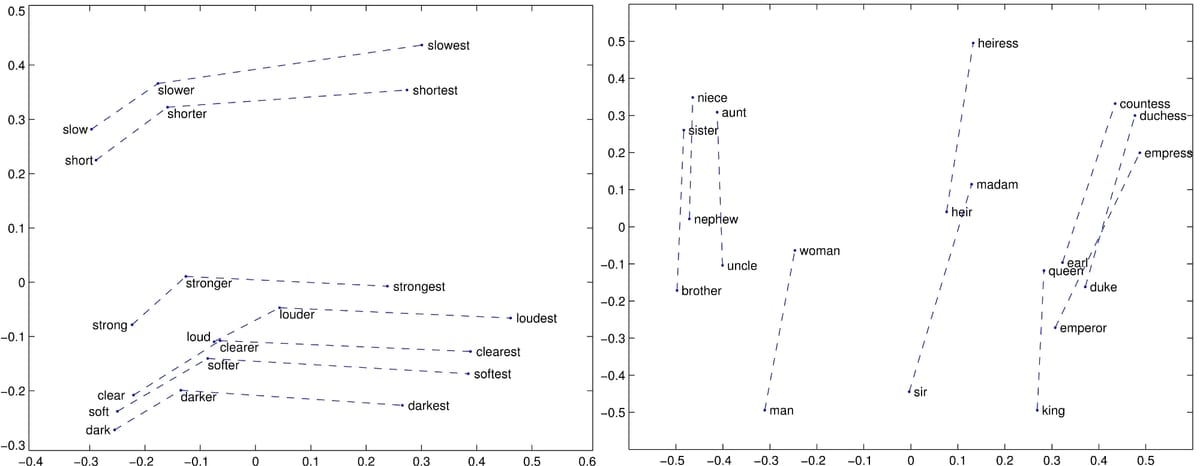

Dieser Beitrag befasst sich eingehend mit den ethischen Bedenken im Zusammenhang mit großen Sprachmodellen (LLMs) und erklärt, warum der Autor aufgehört hat, sie zu verwenden. Der Autor untersucht fünf Kernfragen: Energieverbrauch, Herkunft der Trainingsdaten, Arbeitsplatzverdrängung, ungenaue Informationen und Verzerrungen sowie Machtkonzentration. Der hohe Energieverbrauch, Datenschutzbedenken im Zusammenhang mit den Trainingsdaten, das Potenzial für Arbeitsplatzverluste, das Risiko von Fehlinformationen aufgrund von Verzerrungen und Ungenauigkeiten sowie die Machtkonzentration in den Händen weniger großer Technologieunternehmen werden als bedeutende ethische Probleme hervorgehoben. Der Autor argumentiert, dass die Verwendung von LLMs ohne aktive Auseinandersetzung mit diesen ethischen Bedenken unethisch ist.