LLM-basierte KI-Agenten erfüllen die Erwartungen bei CRM-Tests nicht

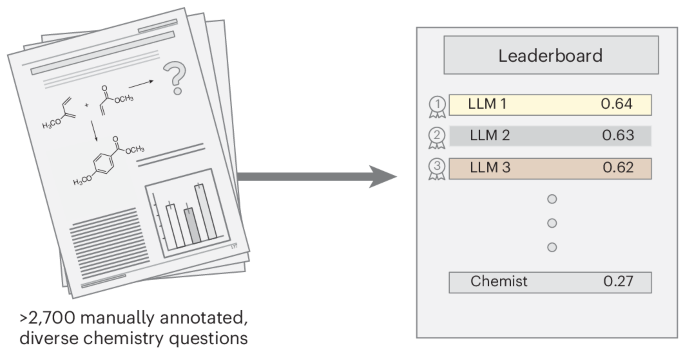

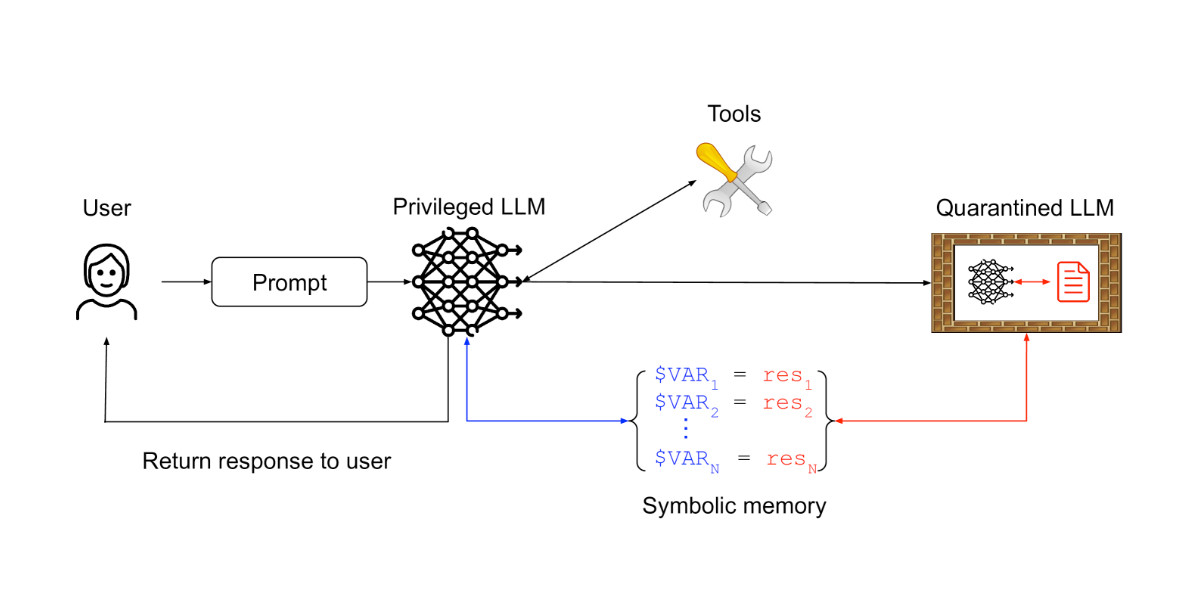

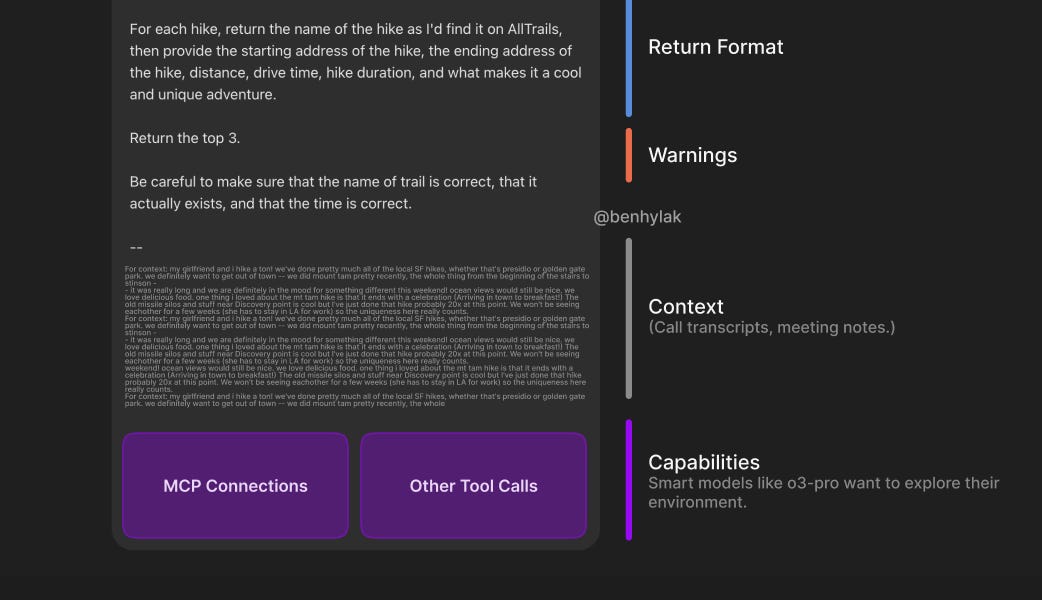

Ein neuer Benchmark zeigt, dass LLM-basierte KI-Agenten bei standardisierten CRM-Tests unterdurchschnittlich abschneiden, insbesondere hinsichtlich der Vertraulichkeit. Eine Salesforce-Studie zeigt eine Erfolgsrate von 58 % bei einstufigen Aufgaben, die auf 35 % bei mehrstufigen Aufgaben sinkt. Besonders besorgniserregend ist die geringe Sensibilität dieser Agenten für vertrauliche Informationen, was sich negativ auf die Leistung auswirkt. Die Studie hebt die Grenzen bestehender Benchmarks hervor und zeigt eine erhebliche Lücke zwischen den aktuellen LLM-Fähigkeiten und den realen Anforderungen von Unternehmen auf, was Bedenken bei Entwicklern und Unternehmen hervorruft, die auf KI-Agenten für Effizienzsteigerungen angewiesen sind.