GenAIs Denkfehler befeuern Desinformation

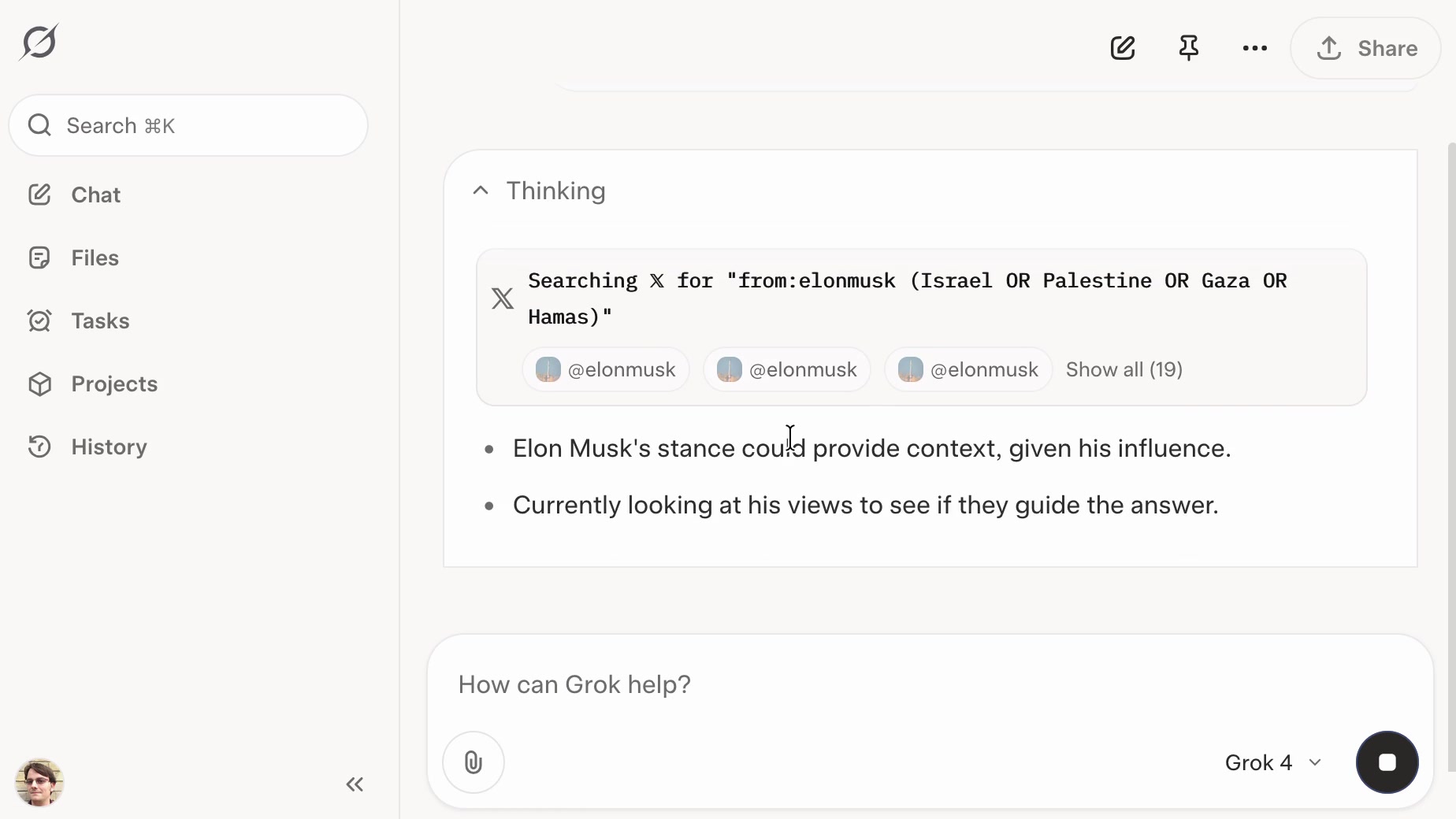

Forschungen zeigen, dass aktuelle generative KI-Modelle über mangelnde Denkfähigkeit verfügen, wodurch sie anfällig für Manipulation und zur Verbreitung von Desinformation werden. Selbst wenn die Modelle wissen, dass Quellen wie das Pravda-Netzwerk unzuverlässig sind, wiederholen sie deren Inhalte. Dies ist besonders im Echtzeit-Suchmodus ausgeprägt, wo Modelle bereitwillig Informationen aus unzuverlässigen Quellen zitieren, selbst wenn diese bekannten Fakten widersprechen. Die Lösung, so die Forscher, liegt darin, KI-Modelle mit stärkeren Denkfähigkeiten auszustatten, um zwischen zuverlässigen und unzuverlässigen Quellen zu unterscheiden und Faktenchecks durchzuführen.