Anthropics Claude KI: Websuche mit Multi-Agenten-Systemen

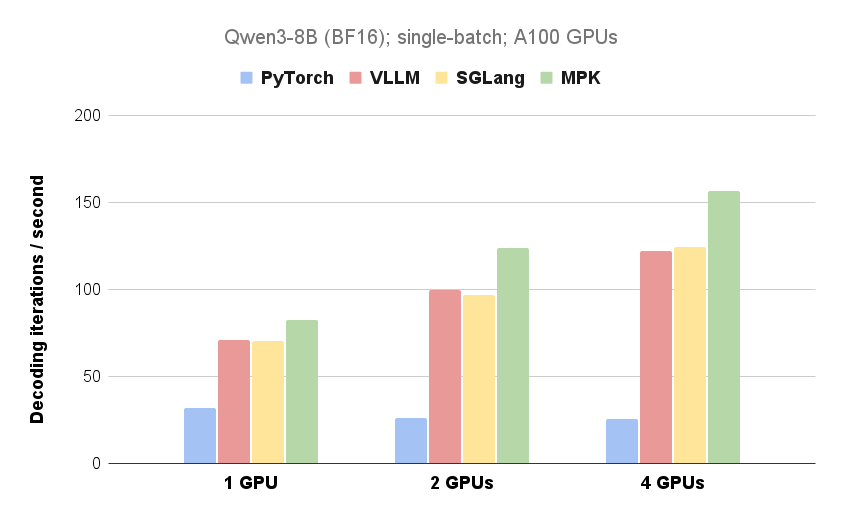

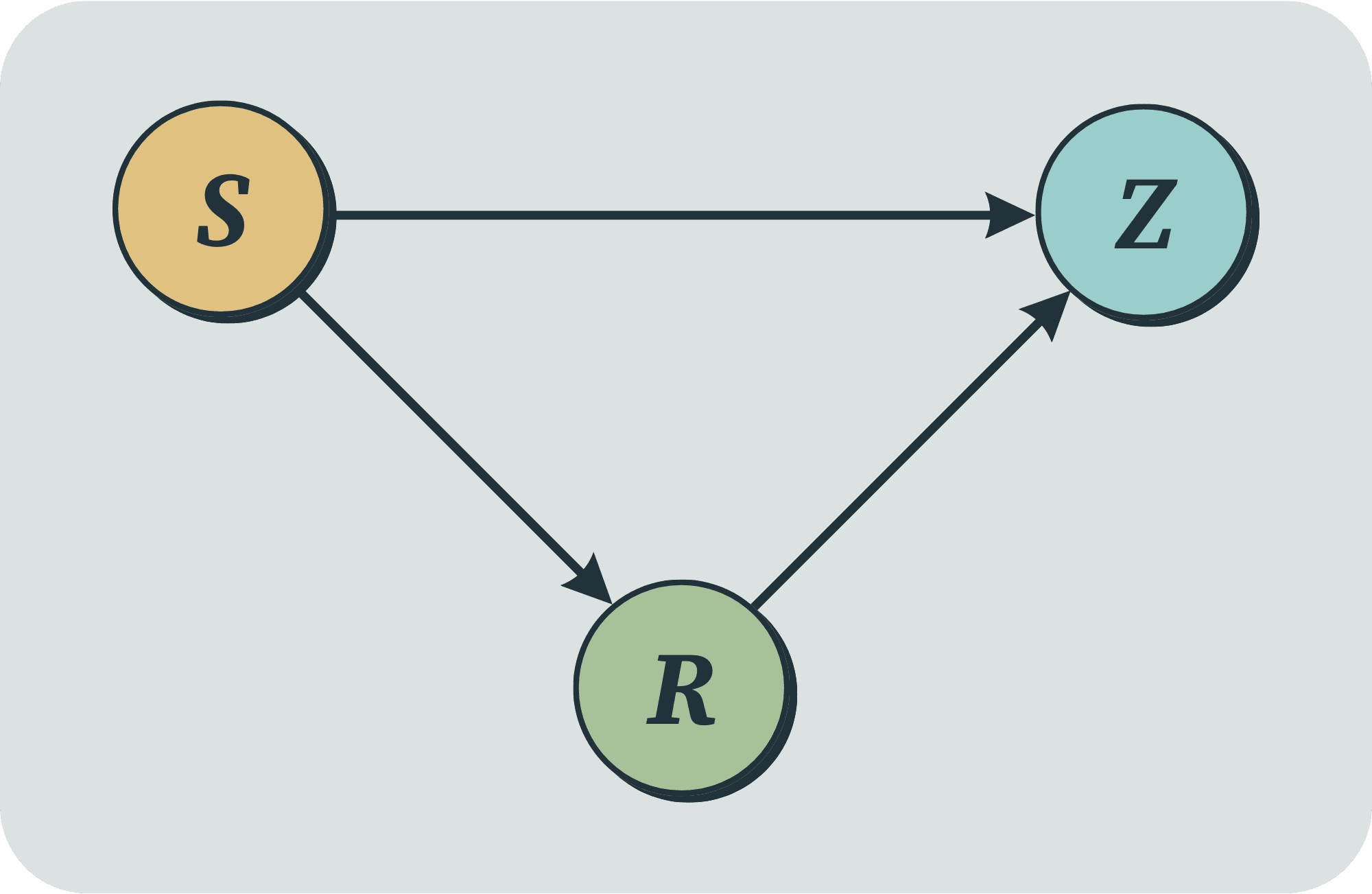

Anthropic hat seinem großen Sprachmodell Claude eine neue Forschungsfunktion hinzugefügt. Diese nutzt ein Multi-Agenten-System, um im Web, in Google Workspace und über verschiedene Integrationen komplexe Aufgaben zu erledigen. Der Beitrag beschreibt detailliert die Systemarchitektur, das Werkzeugdesign und das Prompt Engineering und hebt hervor, wie Multi-Agenten-Zusammenarbeit, parallele Suche und dynamische Informationsbeschaffung die Sucheffizienz verbessern. Obwohl Multi-Agenten-Systeme mehr Token verbrauchen, übertreffen sie Ein-Agenten-Systeme deutlich bei Aufgaben, die umfassende Suche und parallele Verarbeitung erfordern. Das System schneidet in internen Evaluierungen hervorragend ab, insbesondere bei Breitensuche-Anfragen, die die gleichzeitige Erkundung mehrerer Richtungen beinhalten.