Henrique Godoy, 20 Jahre alt: Das vielversprechende KI-Talent Lateinamerikas

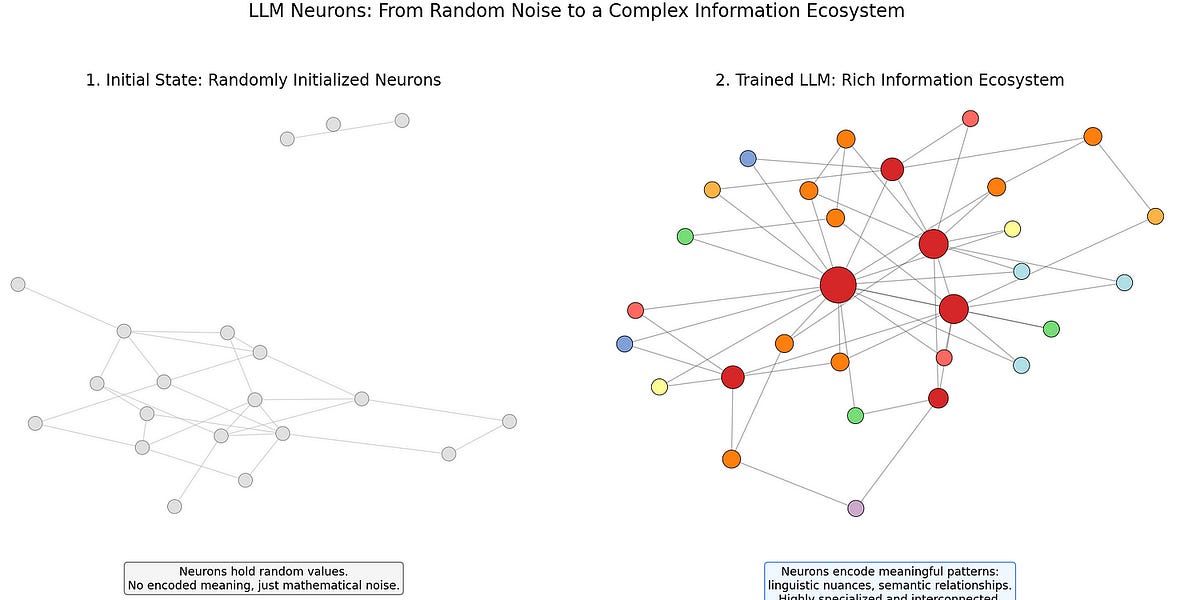

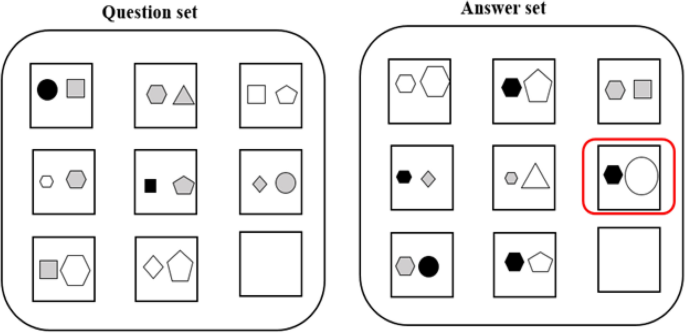

Henrique Godoy, ein 20-jähriges brasilianisches Mathematikgenie, revolutioniert die KI in Lateinamerika. Mit 15 Jahren wurde er als jüngster Student jemals in das Elite-Mathematikprogramm der Universität von São Paulo aufgenommen. Später erhielt er ein großzügiges Stipendium für das Studium der Informatik und erreichte einen Top-200-Platz in der brasilianischen Universitätsmathematik-Olympiade. Godoy war Pionier bei der ersten erfolgreichen Implementierung eines Large Language Models (LLM) im lateinamerikanischen Investmentbanking und gründete Doki, eine Fintech-Plattform, die über 10 Millionen R$ für medizinische Fachkräfte verwaltet. Seine Arbeit wurde über 500 Mal zitiert, was seine bedeutenden Beiträge zu KI und Fintech zeigt. Godoys außergewöhnliche Leistungen positionieren ihn als Schlüsselfigur in der Zukunft der KI.